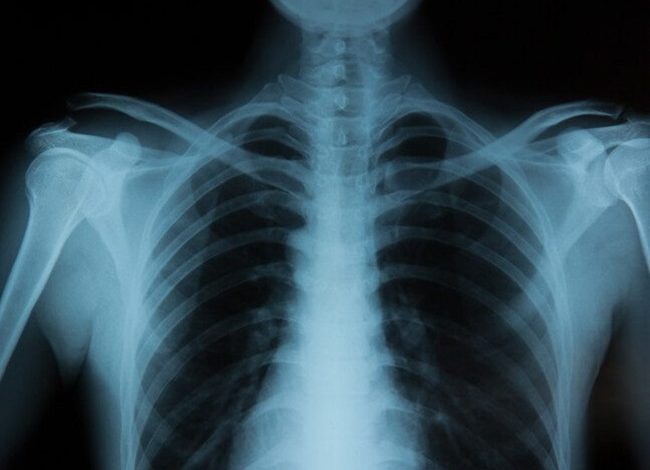

تشخیص هویت نژادی از روی تصاویر اشعه ایکس با هوش مصنوعی

تیم بینالمللی متشکل از محققان سلامت از ایالات متحده، کانادا و تایوان با در اختیار داشتن صدها هزار تصویر اشعه ایکس از افراد مختلف به همراه اطلاعات کامل نژادی از آنها، فناوری هوش مصنوعی را آموزش دادند که میتواند از روی تصاویر نژاد را تشخیص بدهد.

محققان در مقاله خود نوشتند: «هدف ما این بود که یک ارزیابی جامع از توانایی هوش مصنوعی در تشخیص هویت نژادی بیمار از روی تصاویر پزشکی انجام دهیم.»

تحقیقات جدید نشان میدهد مدلهای یادگیری عمیق مبتنی بر هوش مصنوعی میتوانند نژاد افراد را از طریق اشعه ایکس شناسایی کنند.

هوش مصنوعی به دلیل ماهیت خود، تفکر انسان را تقلید میکند تا به سرعت الگوها را در دادههای وارد شده تشخیص دهد. دقت این سیستم در تشخیص – حتی زمانی که تصاویر بسیار مشابه بود و یا برخی سرنخها در رابطه با تراکم استخوان حذف شده بود – در حدود 90 درصد است که رقم شگفتانگیزی است.

از آنجا که این کار برای پزشکان در نگاه کردن به تصاویر مشابه غیرممکن است، این توانایی یادگیری عمیق دانشمندان را نگران کرده است.

این یافتهها سوالات نگرانکنندهای را در مورد نقش یادگیری عمیق در تشخیص، ارزیابی و ارائه خدمات درمانی مطرح میکند: آیا سوگیری نژادی میتواند به صورت ناخواسته توسط نرمافزارها اعمال شود؟ این سوگیری چه اثراتی بر روی فرآیند درمان و به طور کلی، علم پزشکی دارد؟

یادگیری هوش مصنوعی را میتوان برای پیشبینی نژاد از تصاویر ایکس افراد آموزش داد. با اینحال، هوش مصنوعی به صورت ناخواسته سبب سوگیری نیز میشود.

درحال حاضر دانشمندان مطمئن نیستند که چرا سیستم یادگیری عمیق مذکور توانایی بالایی در شناسایی نژاد از روی تصاویر دارند. حتی زمانی که اطلاعات محدودی وارد میشود – برای مثال، با حذف سرنخهایی از تراکم استخوان یا اعضای کوچکی از بدن – باز هم مدلهای هوش مصنوعی در حدس زدن نژاد به صورتی حیرتانگیز عمل میکنند.

دانشمندان حدس میزنند این سیستمها اطلاعاتی از رنگدانه پوست را دریافت میکنند که هنوز برای علم ناشناخته است.

محققان عقیده دارند باید در استفاده از این سیستم در علم پزشکی دقت بیشتری به کار برد. آنها باور دارند تصمیمات نژادپرستانه یا جنسیتی که توسط این سیستم گرفته میشوند، در آینده مشکلساز خواهند بود.